「AIで人件費を削減できる」という話を、最近やたらと耳にする。

でも自分はずっと違和感があった。本当にそんなに単純な話なのか、って。

NvidiaのVPが言ってしまったこと

Nvidiaの応用深層学習担当VPであるBryan Catanzaroが、2026年4月のAxiosの取材でこんな発言をしている。

「自分のチームでは、コンピュートのコストは従業員のコストをはるかに超えている」

AIインフラを売る側の人間が、自社チームでもそうなっていると認めた。これは象徴的な発言だと思う。

Uberで起きたこと

Uber CTOは、2026年のAI予算をわずか4ヶ月で使い切ったと認めている。

エンジニアの95%がAIツールを使用し、コードの70%がAI由来になった。

一方でエンジニア1人あたりの月間APIコストは500〜2000ドルに達した。

「効率化した」はずが、予算は爆発した。これが今のAI導入の現実だ。

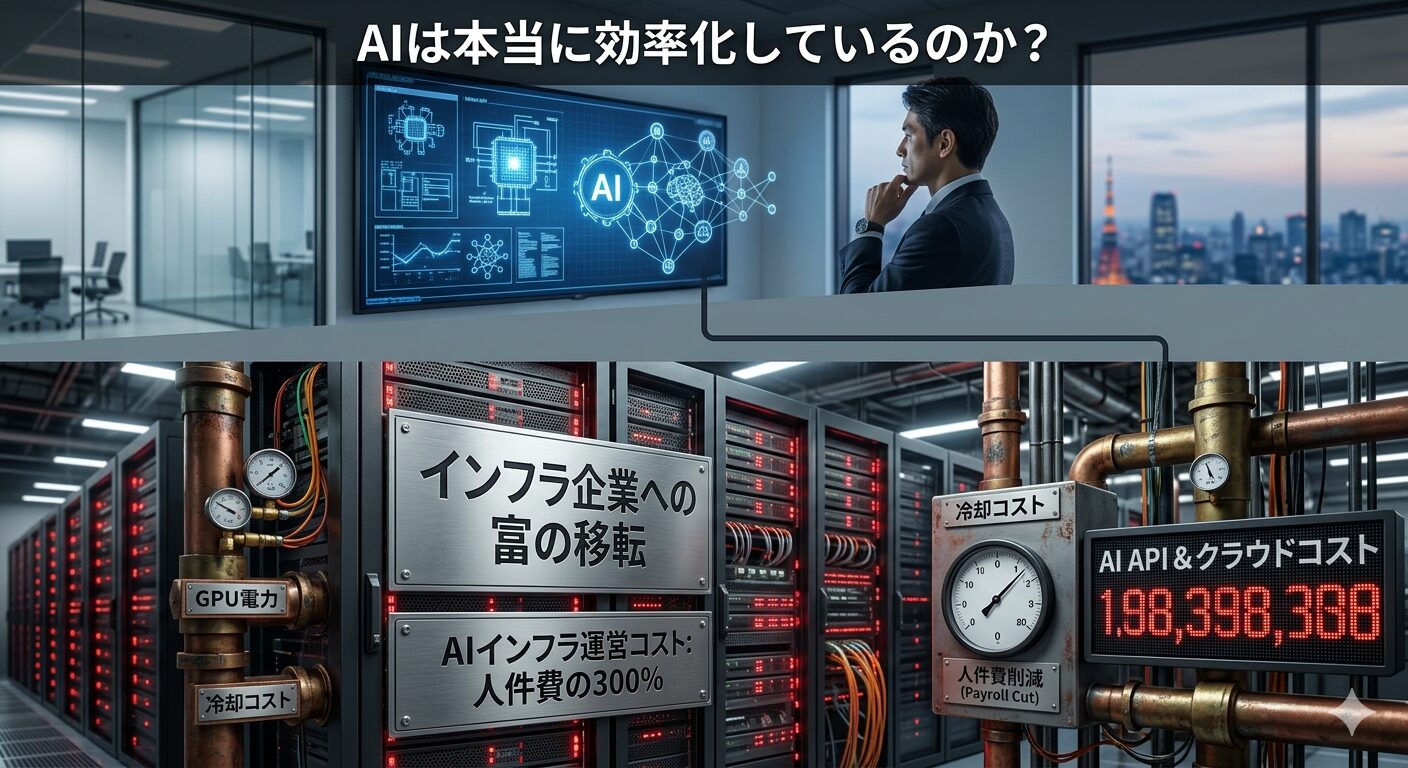

シェルゲームという指摘

あるX投稿が、この構造を「シェルゲーム」と表現していた。企業がAIで人を減らしても、そのお金はNvidiaやAnthropic、OpenAIに流れるだけ。株価は上がるが、実体経済の効率化は起きていない、という主張だ。

事実として、Big TechのAI関連の設備投資は2026年に約74兆円規模になるとも言われている。その多くがGPU、データセンター、電力インフラに向かっている。

指摘自体は鋭い。でも自分は「シェルゲームだから無意味」とは思っていない。

ピックアンドショベルとして見る

ゴールドラッシュで一番儲けたのは金を掘った人ではなく、ツルハシを売った人だった。

今のAIブームで確実に儲かっているのはインフラ層だ。GPU、クラウド、電力、データセンター。これはバブルかもしれないが、過去の鉄道・電力・インターネットの過熱投資も同じパターンをたどった。過熱→淘汰→本格普及。

自分が注目するのは、この流れの中で日本の小型株にどんな影響が出るかだ。電力インフラ、省エネ技術、製造設備──AIの恩恵が間接的に波及する領域は意外と広い。

本当の勝負は2027年以降

MIT研究によれば、現時点でAIが経済的に合理的な代替になれる職種は限定的だ。inferenceコストは急落傾向にあるが、まだ「高額な実験段階」にある。

生産性効果が実際にマクロデータに現れるかどうかは、2027年以降の勝負になるだろう。

今は「AIコストをどうコントロールするか」が企業の実力を分ける時代だ。モデルの選択、キャッシュの活用、プロンプトの最適化。ここに差がつき始めている。

海外の投稿に触発され、自分なりの視点を加えて書きました。 元投稿:@ric_rtp